メルマガ登録

ChatGPTやGeminiなどの生成AIサービスが注目され、さまざまな分野におけるAIの有効活用が現在期待されています。その一方、犯罪に生成AIが悪用されるケースを耳にするようになりました。また、生成AI活用による情報漏えいなども増加傾向にあります。こうした事案が増え続けると、AIについての知識が薄い方や、まだAIを導入していない企業にとっては、AIの使用は危険が伴うという印象を持たれるかもしれません。このようなAI活用におけるリスクを回避するべく、AIに関する規制が国内外で進められつつあります。

そこで本記事では、海外や日本におけるAI規制について解説。日本企業が取るべき対策についても紹介します。(本記事は2025年5月末の情報を元に執筆しています)

国内では、AIを悪用してどのような犯罪が行われたのでしょうか。例をいくつか紹介します。

2025年2月には男子中高生3人が、他人のIDパスワードで不正ログインし、携帯キャリアの通信回線を契約したとして、不正アクセス禁止法違反と電子計算機使用詐欺の疑いで逮捕されました。この事件では生成AIを補助的に利用して自作したプログラムを使って自動的に契約を繰り返し、1,000件以上の回線を契約していたとみられています。

また2025年4月に起きた事件では、生成AIで作成したわいせつなポスターをインターネットオークションで不特定多数に販売したとして、男女4人がわいせつ図画頒布容疑で逮捕されました。

これらの事件は犯罪でAIが悪用されたのであって、AIの使用そのものが罪に問われたわけではありません。ですが、AIの使用が罪になる場合はあるのでしょうか? AIに関する規制について詳しく見ていきましょう。

冒頭で紹介したAIを悪用した犯罪の他、生成AIによって情報漏えいが起きるなど、AIの安全性リスクについて耳にする機会が日本でも増えてきています。「日本のAI開発・活用は遅れている」「国民の多くがAIに対して不安を感じている」と捉える日本政府は、イノベーションを促進しつつリスクに対応するためにはAIに関する新たな法律が必要だとし、海外のようにAI技術を適切に利用することを目的とした法律や規制、ガイドラインなどの制定を進めています。

経済産業省と総務省は、既存のガイドラインを統合・アップデートし、2024年4月19日に「AI事業者ガイドライン(第1.0版)」を公表しました。これは、AIの開発や提供、利用にあたっての必要な取り組みについての基本的な考え方を示しており、AIが安全安心かつ有効的に活用されるための基本的な考え方を示すものです。

AI事業者ガイドラインは法的拘束力を持たないため、企業への強制力はありません。とはいえ、AI事業者が自発的に取り組むべき事項を示すソフトローとして企業活動の行動指針となり、社会的な信頼を築くために重要な役割を果たします。企業はこのガイドラインに従うことでリスクを低減し、社会的責任を果たす姿勢を示せます。

2025年の通常国会に「人工知能関連技術の研究開発及び活用の推進に関する法律案」(AI推進法)が提出され、同年5月28日の参議院で可決・成立しました。

AI推進法は、AIの利活用を通じた「国民生活の向上」と「経済発展」を目的とした法律です。主に以下の内容が盛り込まれています。

また、AIを規制するよりも、AIの利活用を促す「推進法」としての側面が強く、罰則も設けられないものになり、今後の施行に向けて政令や省令の制定が進められていきます。

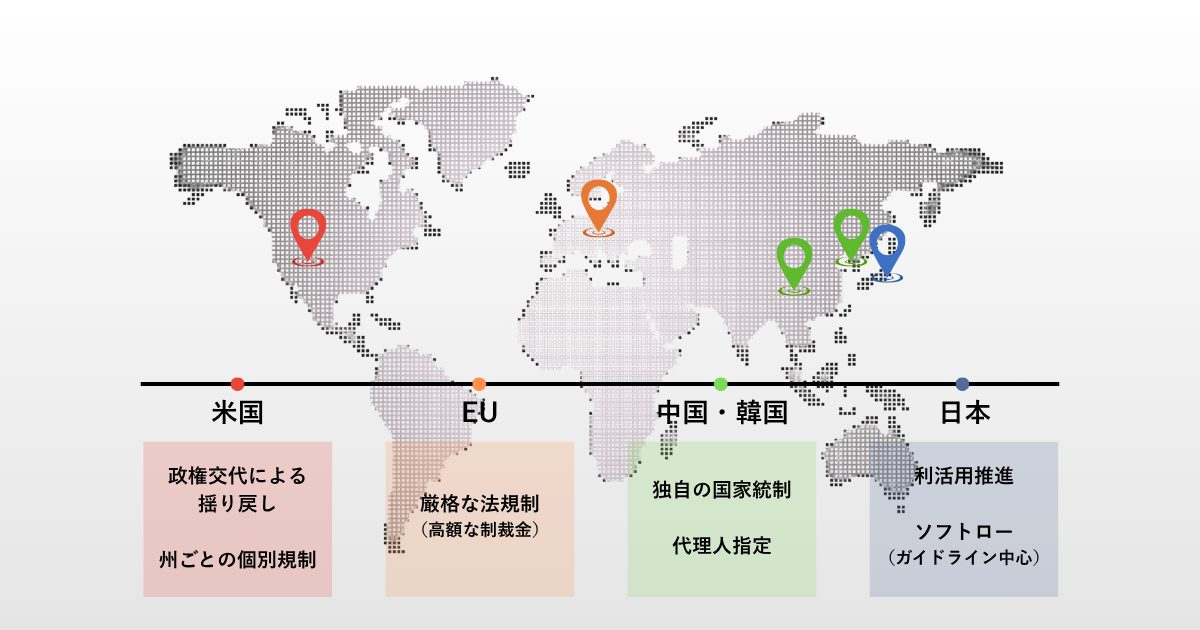

日本のAI規制は利活用を促す方向になりますが、海外ではどうでしょうか。ある国では厳しい罰則が設けられていたり、ある国では規制が何もなかったりと、海外におけるAI規制は現在、国によってさまざまです。すでに規制が制定されている主なAI先進国の動向を紹介します。

EUでは2024年5月、生成AIを含む包括的な規制「AI法(Artificial Intelligence Act)」が成立しました。2024年8月に発効され、2030年末までに段階的に施行されます。

企業にとって特に注意すべきは、高額な制裁金です。2025年8月以降、違反内容に応じて以下のいずれか高い金額が科される可能性があります。

AI法は、AIシステムにおけるリスクの発生可能性と影響度を分析し、優先順位をつけて重要なものから対策する「リスクベースアプローチ」に基づいており、以下の4つのカテゴリーで異なる規制が設定されています。

人々の安全、生活、権利に対する明らかな脅威と見なされる、すべてのAIシステムが対象となります。例えば、「脆弱性を悪用するAI」「職場や教育機関における感情認識」「サブリミナル技術による潜在意識の操作」などが該当し、原則として使用が禁止されます。

人々の健康、安全、基本的権利に深刻なリスクをもたらす可能性のあるAIシステムが対象になります。例えば、「交通など重要インフラのAI」「試験の採点など教育機関で使用されるAI」「企業の採用活動で使用されるAI」「ロボット支援手術など医療機器のAI」などが該当し、リスク管理やデータガバナンス、人的監視措置、ログの保存などの厳格な規制が課されます。

AIシステム使用における、透明性に関連するリスクが対象になります。例えば、チャットボットなどを使用する場合、人間にAIと対話していることを認識させ、十分な情報に基づいた意思決定を行えるようにする義務が課されます。また、最近よく見られる生成AIによるコンテンツなども、AIによって生成された旨を明示する必要があります。

AI対応のビデオゲームやスパムフィルターなど一般的なAIアプリケーションに関しては、自由に利用可能で特別な制限は現在ありません。

米国では2025年の政権交代によって、AIに関する規制の見直しが急速に進んでおり、今後の動向を注視する必要があります。また、連邦レベルの規制だけでなく、一部の州では独自の規制が設けられており、注意が必要です。

米国では、バイデン政権下の2023年10月に「AIの安心、安全で信頼できる開発と利用に関する大統領令(The Executive Order on Safe, Secure, and Trustworthy Development and Use of Artificial Intelligence)」が発令され、AIに対する規制が強化される方向性が示されました。しかし、この大統領令は2025年1月に就任直後のトランプ大統領によって撤回され、新たに「AIにおける米国のリーダーシップへの障壁を取り除く大統領令(Removing Barriers to American Leadership in Artificial Intelligence)」が発令されています。

新たな大統領令では「AI行動計画の策定」が掲げられている他、AI向け半導体の輸出規制強化策を撤回するなど、バイデン政権下に定められたポリシーや規制などの見直しが急速に進んでいます。

ユタ州では2024年5月に「生成AIポリシー法(Artificial Intelligence Policy Act)」が施行されました。この法律では、同州の消費者保護部門が監督する行為に関連して、生成AIと利用者を対話させるサービスの提供事業者は、利用者から求められた場合には対話しているのが生成AIであることを開示しなければなりません。また、一定の免許・認証などが必要なサービスに生成AIを利用する際にも、生成AIを利用していることを明示する必要があります。

コロラド州では、2024年5月に包括的なAI規制法「コロラドAI法(Colorado AI Act)」が成立し、2026年2月に施行されました。この法律は、雇用や就職機会、教育の登録や機会、金融・医療などに重大な影響を与える、高リスクなAIシステムの開発者と提供者に適用されます。これらのAIシステムを利用した際の「アルゴリズムによる差別」について、既知または合理的に予見可能なリスクから消費者を保護するために注意を払うことが義務付けられています。

カリフォルニア州では、すでに多くのAI関連法が制定されています。特に注目されるのが、2026年1月に施行された、月間100万人以上の利用者がいる生成AIシステムの開発事業者が対象の「AI透明化法(AI Transparency Act)」と、生成AIの訓練に用いたデータセットの概要を一般に公開することを求める「生成AI訓練データ透明化法(AB-2013 Generative Artificial Intelligence : Training Data Transparency)」です。前者は、画像・映像・音声が生成AIによって生成・改変されたことがわかるAI検出ツールを、ユーザーに無償で提供する必要があります。後者は、生成AIのシステムまたはサービスの開発者に対して、開発に使用したデータセットの概要を記載したサマリーをWebサイト上で公表することが義務付けられています。

韓国では2024年12月に、「AIの開発と信頼基盤の形成に関する基本法(AI基本法)」が成立し、2026年1月に施行されました。この法律は、主に「高影響AI」「生成AI」を規制対象としており、「AIベースであることを通知する義務」「国内代理人を指定する義務」「科学技術情報通信部による停止または是正命令に従う義務」に違反すると、3,000万ウォン以下の罰金が科されます。

中国では2023年8月に「生成AIサービス管理暫定弁法」が施行されており、生成AIを活用したサービスを提供する事業者は、「適法なデータと基本モデルを使用すること」「他者の知的財産権に侵害しないこと」などが義務付けられています。違反した場合は、サイバーセキュリティ法やデータセキュリティ法、個人情報保護法などに基づいて処罰や行政処分が行われ、状況に応じて治安管理上の責任または刑事責任が追及される場合もあります。

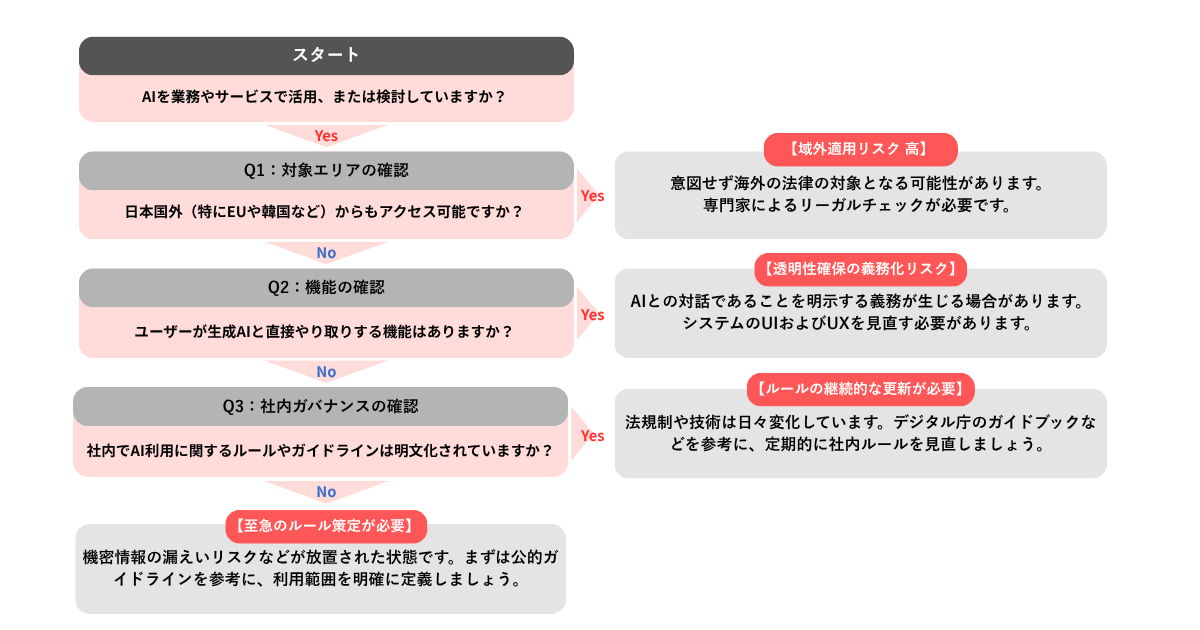

ここまでの内容を踏まえて、AIを活用する企業が注意すべき点や取るべき対策について解説します。

自社サービスがインターネット経由で海外から利用できる場合、現地の法令が適用される「域外適用」のリスクがあります。以下のような各国の独自ルールに抵触しないか、法務確認を徹底してください。

AIのリスク(誤情報の生成や機密情報の漏えいなど)を防ぐには、公的なガイドラインをベースにした社内ルールの策定が有効です。 デジタル庁が公開した「行政の進化と革新のための生成AIの調達・利活用に係るガイドライン」などを活用し、自社の利用ガイドラインをアップデートしましょう。

AI技術と法規制は日進月歩で変化しています。自社のみで法務リスクを完全にカバーすることは困難です。AIの実装フェーズにおいては、データサイエンスや法律の専門家と連携できる体制を構築することが重要です。

※この記事は概要を伝えるためのものであり、実際の事業展開においては法務部門や専門家への確認が必須です。

AIはこれまで人々が体験したことがないさまざまなサービスや製品を生み出す、無限の可能性を持ったツールです。技術の発展が目覚ましい一方、法律やルールは整備が追い付いていない状況とも言えますが、いずれは世界共通でAI活用がルール化される日が来るかも知れません。法律やAIの専門家などに相談しながら、今から将来に備えておくことも必要でしょう。

あなたにオススメの記事

2023.12.01

生成AI(ジェネレーティブAI)とは?ChatGPTとの違いや仕組み・種類・活用事例

2023.09.21

DX(デジタルトランスフォーメーション)とは?今さら聞けない意味・定義を分かりやすく解説【2024年最新】

2023.11.24

【現役社員が解説】データサイエンティストとは?仕事内容やAI・DX時代に必要なスキル

2023.09.08

DX事例26選:6つの業界別に紹介~有名企業はどんなDXをやっている?~【2024年最新版】

2023.08.23

LLM(大規模言語モデル)とは?生成AIとの違いや活用事例・課題

2024.03.22

生成AIの評価指標・ベンチマークとそれらに関連する問題点や限界を解説