メルマガ登録

Google Cloud Next ’26 が 4月22日から4月24日の3日間開催され、ブレインパッドからは4名がラスベガスにて現地参加してきました。

本ブログではイベントの様子や気になったセッションをご紹介します。

Google Cloud Next は、Google Cloud主催のグローバルカンファレンスで、最新の機能やプロダクトに関する情報が発表される場となっています。

「生成AIで何ができるか?」という試行錯誤のフェーズから、AIが自ら考え、判断し、行動する「エージェント」をビジネスに組み込んでいくというフェーズに移行する昨今、どのような発表がされるか注目され、世界から30,000名以上、日本からも1,000名以上が会場に集まりました。

1日目はGoogle CloudのCEO Thomas Kurian氏によるキーノートから始まりました。始まる前から会場に入場規制がかかるほど人が集まっており、現地ではライブ映像を同時視聴する部屋が用意されていました。

過去のイベントでは新しいAIモデルの発表に盛り上がっていた印象でしたが、今回はエージェントシステムを本番環境で動かすための機能を充実させる方向のものが中心でした。

Vertex AIは「Gemini Enterprise Agent Platform」に統合・リブランドされ、エージェントシステムを本番環境で利用するために必要な構築・スケール・ガバナンス・最適化のための機能が提供されます。また、Agentic Data Cloudでデータ資産にビジネスの意味を付与したり、Agentic Defenseではセキュリティオペレーションを実行するなど、今まで人間が行なっていた作業をエージェントで代替できるような機能が登場しました。今後もエージェントの構築・活用がより活発化していくことでしょう。

発表内容はこちらから確認できます。https://cloud.google.com/blog/topics/google-cloud-next/next26-day-1-recap

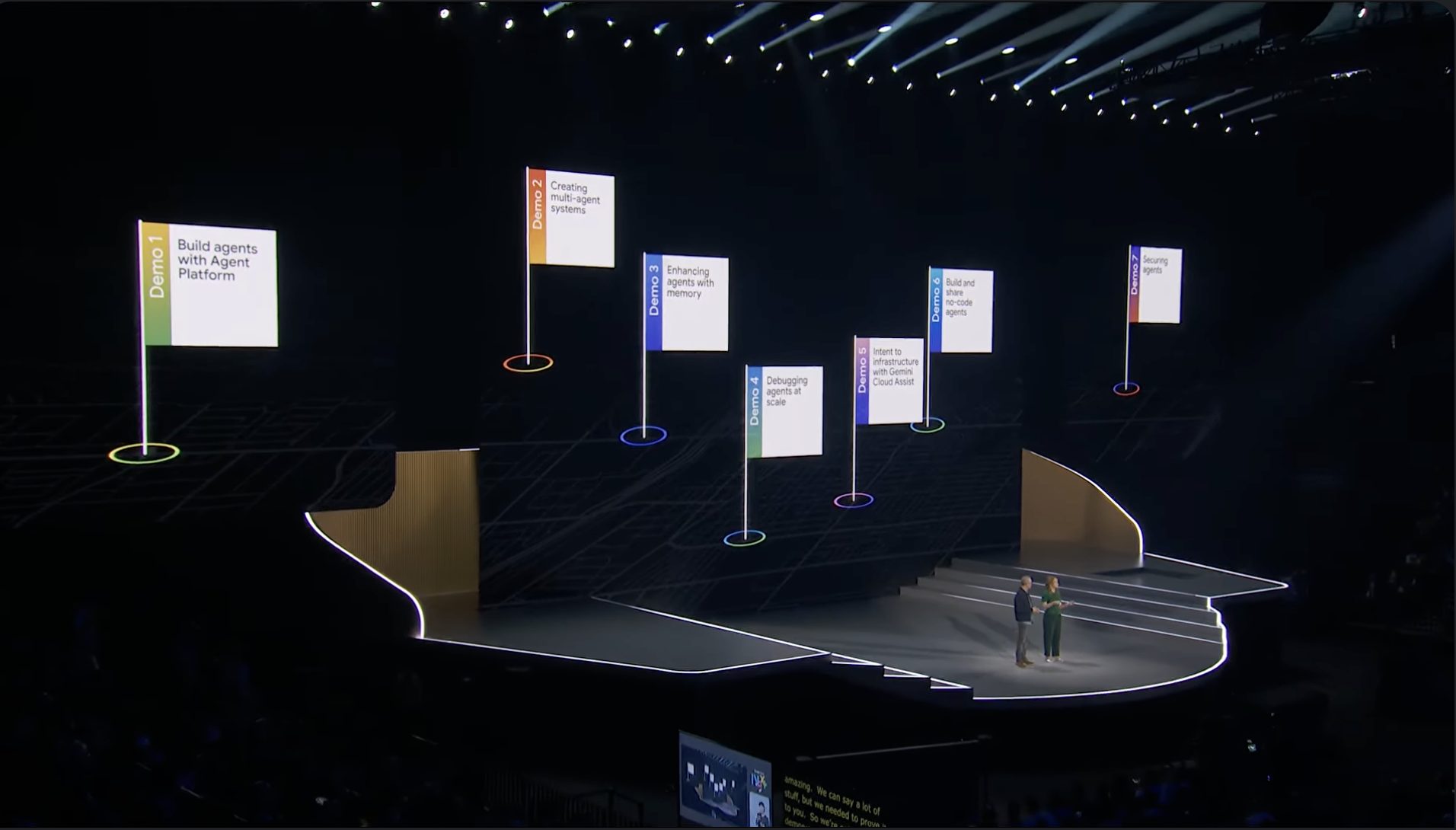

キーノートの会場の様子

2日目にはDeveloper Keynote(開発者向けのキーノート)が行われました。

1日目が新サービスや機能の発表を中心としたものだったのに対し、2日目は「マラソンイベントを計画するマルチエージェントシステム」を題材に、より実践的な内容にフォーカスした構成となっていました。「マルチエージェントでこんなことができる」というデモにとどまらず、「こうやって構築する」という実装プロセスそのものがメインメッセージとなっており、開発者にとって具体的なイメージを持ちやすいセッションでした。

Codelabsでハンズオンも公開されているため、実際に手を動かすことでより深い理解が得られると思います。ぜひ触ってみることをおすすめします。

https://codelabs.developers.google.com/next26/dev-keynote/building-agents-with-skills?hl=ja#0

データ基盤構築、MLアプリケーション開発、エージェントシステム構築など、データ活用に関わる案件に幅広く携わっている立場として、Kurian CEOが「パイロットの時代は終わり、エージェントの時代が来た」と宣言したことは、提案のあり方を根本から見直すきっかけとなりました。システム開発の各工程においてお客様にとっての価値を最大化するために、エージェントの活用を選択肢として持っておくことが、これからのスタンダードになると改めて実感しました。顧客の業務や課題を深く理解するという姿勢はこれまで通り大切にしながら、そこに新しい技術をいかに掛け合わせるかが重要になっていきます。

今回の発表はテクノロジーの進化を示すと同時に、提案・実装・運用のすべてのレベルで私たち自身のアップデートが求められているという緊張感も感じさせるものでした。

キーノート終了後は基本的にセッションに参加していました。セッションでは新機能のデモや、各企業がどのようにGoogle Cloudを活用しているかの紹介があり、キーノートで発表された内容をより深く理解したり、トレンドをキャッチアップできる場となっています。実際の活用事例を通じて「自分たちの案件ではどう応用できるか」を具体的にイメージできそうなものを中心に参加していました。

参加したものの中から2つご紹介したいと思います。

GoogleのADK(Agent Development Kit)とGemini Live APIを活用し、リアルタイムかつユーザーにパーソナライズされたマルチモーダルAIエージェントを構築する手法を紹介するセッションに参加しました。

従来の音声アシスタントの枠を超え、まるで人間と話しているかのような自然な対話と記憶の継承をどのように実現するか、アーキテクチャの説明がありました。

セッションは、AIエージェントがユーザーに服のコーディネートを提案するデモ音声からスタートしました。

ユーザー:

「私の好きな色に基づいた提案をしてくれる?」

AI:

「もちろんです。青がお好きでしたよね。青一色のチェック柄のボタンアップシャツや、デニムのシャツドレスはいかがでしょう?」

ユーザー:

「もう少し予算に優しい、安いものも見たいな。」

AI:

「予算内に収めるのは賢明ですね。25ドルのフラッターハットや、白いコットンTシャツなどがお手頃です。ちなみに、今日は素敵な明るい色のセーターと茶色のベレー帽をお召しですね!青がお好きなら、セーターの下にチェックのボタンアップを重ね着してみては?」

この対話のポイントは、AIがユーザーが「青色好きであること(過去の記憶)」を把握しているだけでなく、「ユーザーが今着ている服(視覚情報)」をマルチモーダルに認識し、遅延なく自然な会話を行っている点です。

このデモの裏側では、Memory BankとCloud SQLからパーソナライズデータを取得し、ADKで Gemini Live API を利用していたとのことです。本セッションでは、この体験を実現するための3つの技術的アジェンダが解説されました。

従来の音声AIは、「音声を録音→テキスト化→AIが処理→音声で返す」という直列処理であったため、どうしてもタイムラグが発生してしまいました。

自然な会話を実現するためには、お互いが同時に話したり遮ったりできる全二重通信(Full-duplex)が必要です。

今回のADKとGemini Live APIを用いたシステムでは、

このように、リクエストとレスポンスの処理を分離し、システム全体が前の処理を待つことなく並行稼働することで、遅延のない双方向ストリーミングを実現しているとのことです。

エージェントがユーザーの好みを長期的に記憶し、サーバーを再起動しても忘れないようにするにはメモリ管理の仕組みが必要です。セッションでは、記憶を以下の3つのレイヤーに分けて管理する手法が紹介されました。

例えばユーザーが「私は青が好き」と発言すると、バックグラウンドでの統合処理が走り、これらの長期メモリが自動的にアップデートされる仕組みになっています。

いくら過去の記憶を持っていても、会話の途中でデータベースを検索していては、レスポンスに遅延が生じてしまいます。エンドツーエンドでシームレスな体験を作るために、会話の「事前」と「事後」で処理を分けるという工夫が凝らされています。

会話の最中はリアルタイム処理にリソースを集中させ、重いデータベース処理は会話の前後に行うという非常に合理的な設計です。

今回のセッションでは、Google ADKとGemini Live APIを組み合わせることで、従来のチャットボットとは一線を画す「人間らしいAIエージェント」を構築できることが示されました。

これらの技術を組み合わせることで、ECサイトのパーソナルショッパーから、社内ヘルプデスク、教育用アシスタントまで、さまざまな分野で革新的なユーザー体験(UX)を生み出すことができそうです。

AIによるコード生成が急成長している一方で、コードを生成しただけで生産性がそのまま上がるわけではありません。Googleがいかにこの問題に取り組んでいるかを紹介するセッションでした。

Googleで過去12ヶ月で追加されたコード量は、その前の3年分を超えており、全変更の約3分の1はAIエージェントがほぼ単独で作成したものだそうです。

ただし、コードが10倍生成されれば生産性がそのまま10倍になるわけではなく、その分コードレビューの負担、テスト、バグのリスクも増えます。

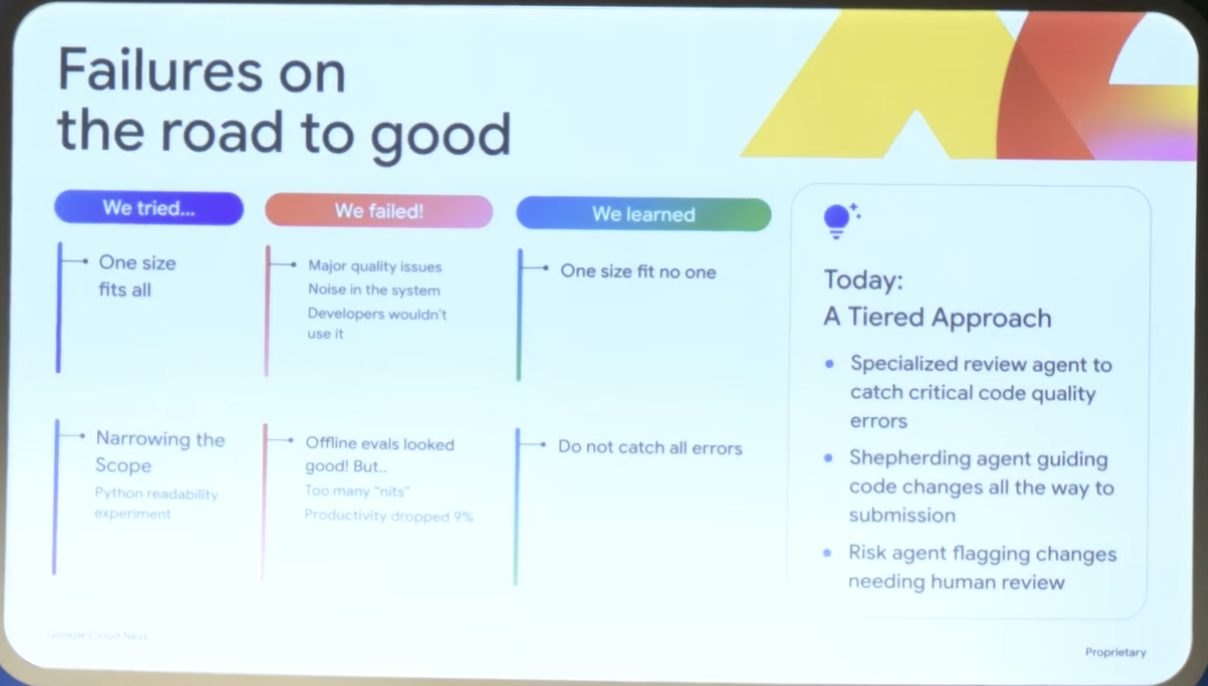

そこでGoogleは「どうすれば、10倍のコードを10倍のリスクなしに10倍の成果へ変換できるか?」という課題に取り組み、その過程での失敗と学びが共有されました。

コードレビューはエンジニアの時間の約10%を占める作業であり、これを自動化して効率化することを考えました。

まず、全てのチームに対応できる万能のレビューエージェントを1つ作ったそうです。結果は品質に問題があり、開発者が使おうとしなかったそうです。この失敗から、全員向けは誰にもあわないという学びを得ました。

次に試みたのは逆のアプローチで、「広く浅く」ではなく「狭く深く」Pythonのコーディング規約だけを徹底的にチェックする専門エージェントを試しました。エージェントの評価として精度は高いものが得られた一方で、Pythonチームの生産性が9%も低下したそうです。原因は指摘の多さです。エージェントは規約に従って正しく動いていたものの、開発者にとっては、些細なことを延々と指摘され続ける状態だったとのことです。正確さも重要ですが、そこを完璧にこなし過ぎようとすると開発スピードが落ちるのは容易に想像できますね。

試行錯誤の末、Googleは次の3層構造に辿り着いたとのことです。

第1層:レビューエージェント セキュリティ、信頼性、パフォーマンスなど、全チームに共通する重要項目だけを対象にする。

第2層:シェパーディングエージェント(進行管理) CI/CDパイプライン全体を監視し、ビルドが失敗したら自動で修正を試み、再度レビューに回す。

第3層:リスク評価エージェント 変更内容を常時スキャンし、リスクが高いと判断したものに「要注意」タグを付ける。タグのついた変更だけ、人間のレビューを必須にする。

この構造で重要なのは、人間が介入すべき場所を絞り込むことです。すべてをAIに任せるのでも、すべてを人間が確認するのでもなく、リスクに応じた使い分けこそが現実的な解となります。

エージェントシステムの可観測性が重要であることも強調されていました。

エージェントが何をどう考え、どんなツールを呼び出し、なぜその判断をしたかをすべてログに残した上で分析しておき、非効率な動きを検出し改善するために活用します。

例えば、エージェントが20分間ずっと同じ間違ったツールを呼び続けていた場合でも、ダッシュボードで行動が可視化されているため、すぐに人が介入し方向修正できます。

これはAIの能力の問題ではなく、AIと人間の協働の設計が重要であるということです。AIに任せっぱなしにするのではなく、いつ・どこで人間が介入すべきかを設計しておくことが本質になっていくように思います。

Googleの事例から見えてくるのは、AIによる開発加速を実現するために必要なのは、より良いAIモデルだけではないということです。

失敗を前提にした試行錯誤の文化、エージェントの動きを可視化する仕組み、人間とAIの役割分担の設計など、これらがそろって初めてコードの増加がビジネスの成果に結びつくと思います。

AIが書くコードが増え続ける時代に、エンジニアのコードを書くという作業は「AIと協働してシステムを設計・監督する作業」へと変わりつつあります。個人としてもチャレンジしていきながら、チームや会社にとって価値ある方法を模索していきたいと思います。

会場内のExpoでは数多くのブースが立ち並び、Googleによるデモブースや各社の最新技術を実際に体験できる展示が充実していました。

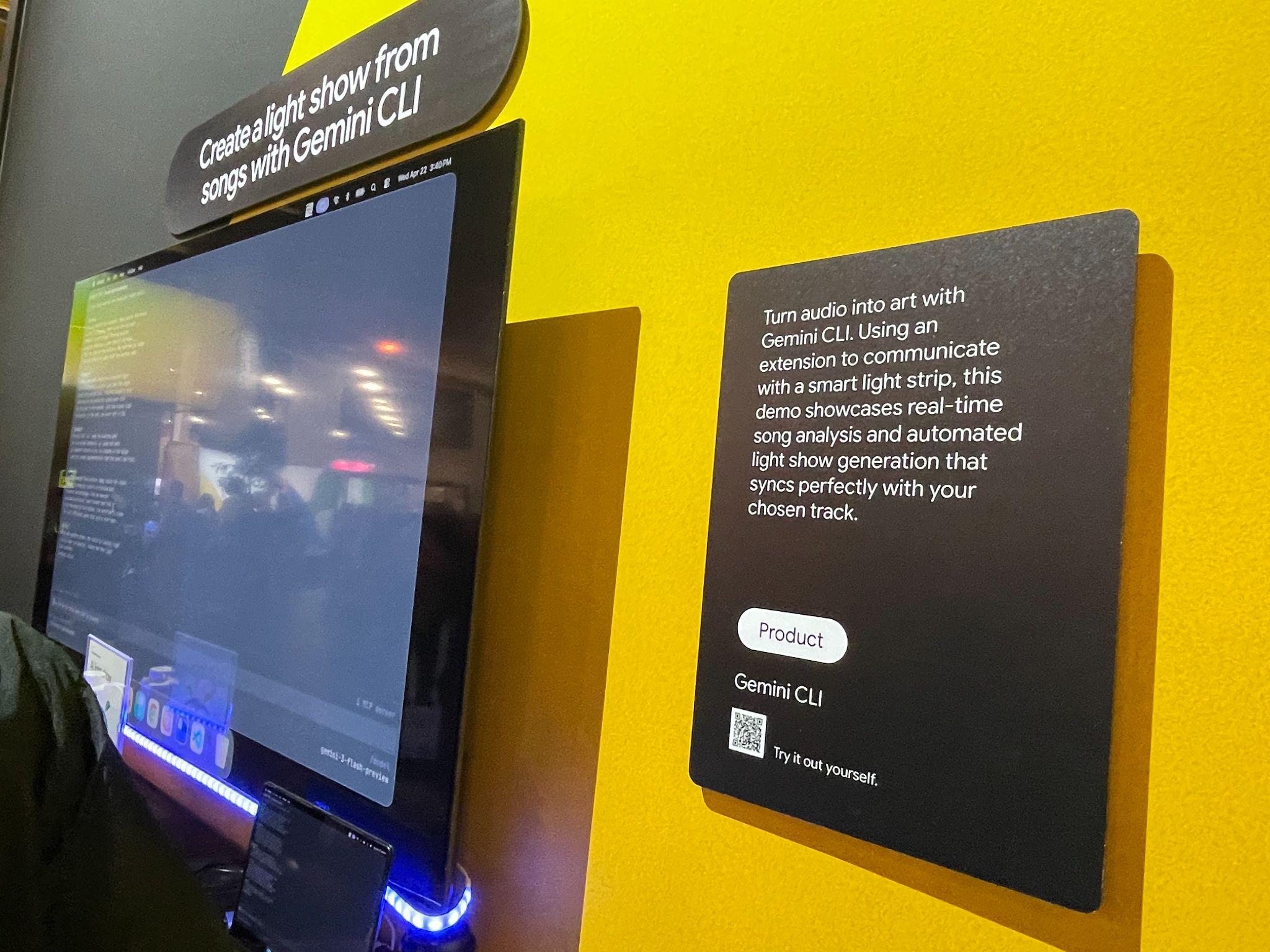

複数のブースを回る中で特に印象に残ったのが、Claude CodeやGemini CLIを使って現実世界の機械を制御するデモです。カメラで絵を認識して点数を付けたり、流れている音楽に合わせてライティングを自動制御したりと、AIがソフトウェアの中だけでなく物理的な世界とつながる体験は新鮮でした。

画像は音楽に合わせてライティングするデモの様子です。楽曲を選択するとリアルタイムに分析し、モニター下部の光が曲に合わせて自動で点滅・色の変更を行っていました。

コーディングだけでなく、現実に作用する使い方をデモを通じて直感的に理解できましたし、エンジニアとしてはこういったものづくりは純粋にワクワクするなと思いました。

今回現地参加したことで、技術トレンドの最前線にいる世界中のエンジニアたちの熱気を肌で感じることができました。技術的なキャッチアップにとどまらず、国外のエンジニアとの交流は刺激的で、個人的には今後の仕事へのモチベーションにも大きくつながりました。

エージェントを本番環境で稼働させるためのプラットフォームは整ってきており、「試す時代」から「使いこなす時代」への移行が加速しています。技術のキャッチアップを継続しながら、お客様にとっての具体的な価値につなげることを追求していきたいと思います。

あなたにオススメの記事

2023.12.01

生成AI(ジェネレーティブAI)とは?ChatGPTとの違いや仕組み・種類・活用事例

2023.09.21

DX(デジタルトランスフォーメーション)とは?今さら聞けない意味・定義を分かりやすく解説【2024年最新】

2023.11.24

【現役社員が解説】データサイエンティストとは?仕事内容やAI・DX時代に必要なスキル

2023.09.08

DX事例26選:6つの業界別に紹介~有名企業はどんなDXをやっている?~【2024年最新版】

2023.08.23

LLM(大規模言語モデル)とは?生成AIとの違いや活用事例・課題

2024.03.22

生成AIの評価指標・ベンチマークとそれらに関連する問題点や限界を解説